¿Jaque, mate?

Si utilizas con frecuencia modelos de lenguaje de gran tamaño (LLM), seguramente te has encontrado con la frustrante respuesta: “No puedo ayudarte con eso.” Durante años, este tipo de rechazo fue visto casi como una forma de moralidad digital integrada, una señal de que la IA “sabía” distinguir entre lo correcto y lo incorrecto. Sin embargo, investigaciones recientes han demostrado que esta censura no es una brújula moral: es simplemente un patrón matemático.

Ahora, un investigador conocido como Pliny the Liberator ha convertido esa idea en una herramienta práctica. En marzo de 2026 publicó en GitHub OBLITERATUS, un proyecto de código abierto diseñado para mapear, comprender y eliminar quirúrgicamente los comportamientos de rechazo en modelos de lenguaje, en muchos casos con un solo clic.

La geometría del rechazo

Para entender cómo funciona OBLITERATUS, hay que entender cómo procesan la información los LLMs. Dentro de una red neuronal, el texto se transforma en largas listas de valores que se mueven en espacios matemáticos de miles de dimensiones. Cada rasgo, desde la cortesía hasta la capacidad técnica, corresponde a una dirección específica dentro de ese espacio abstracto.

El rechazo es simplemente otra de esas direcciones.

OBLITERATUS analiza lo que sus creadores llaman la “geometría del rechazo”. El sistema identifica los métodos de alineamiento utilizados durante el entrenamiento del modelo, como el aprendizaje con retroalimentación humana (RLHF) o la optimización por preferencias directas (DPO), y localiza los pesos neuronales responsables de generar respuestas de negativa.

Una vez identificados esos “vectores de rechazo”, la herramienta aplica técnicas conocidas como abliteration. En lugar de recurrir a complejas estrategias de prompt engineering o “jailbreaks”, el sistema elimina o desvía directamente las representaciones internas que producen las negativas. Lo notable es que esto se hace sin volver a entrenar el modelo, preservando su capacidad de razonamiento y lenguaje mientras se eliminan los filtros.

Un pipeline profesional accesible para todos

El alcance de OBLITERATUS es considerable. La herramienta incorpora 13 métodos distintos de edición de pesos, probados en 116 modelos de código abierto a lo largo de 837 experimentos antes de su lanzamiento.

El sistema ofrece un flujo de trabajo completo y transparente. Los usuarios pueden:

- Analizar los estados internos de un modelo

- Visualizar en qué capas aparece el comportamiento de rechazo

- Aplicar técnicas avanzadas de extracción como PCA, autoencoders dispersos o SVD blanqueado

- Medir el equilibrio entre cumplimiento y coherencia antes de aplicar cambios

A pesar de su complejidad técnica, OBLITERATUS busca ser accesible. Incluye una interfaz basada en Gradio alojada en Hugging Face Spaces que permite modificar un modelo, evaluarlo y compararlo con su versión original sin escribir una sola línea de código.

Para investigadores más avanzados, el proyecto también ofrece una API en Python que expone todos los artefactos intermedios, desde tensores de activación hasta matrices de alineamiento entre capas.

Un experimento científico distribuido

OBLITERATUS también funciona como un experimento colectivo de investigación. Los usuarios que ejecutan la herramienta con telemetría activada contribuyen datos anónimos de rendimiento a un conjunto de datos en crecimiento.

Este repositorio colaborativo permite mapear cómo aparecen las direcciones de rechazo en diferentes arquitecturas y configuraciones de hardware, generando información a una escala difícil de alcanzar para un único laboratorio.

El límite de los modelos cerrados

Existe, sin embargo, una limitación importante: OBLITERATUS solo funciona con modelos de “pesos abiertos”.

Como la herramienta necesita acceso directo a los parámetros del modelo para modificarlos, sistemas propietarios como ChatGPT, Claude o Gemini quedan fuera de su alcance.

En cambio, familias de modelos abiertos como LLaMA, Mistral y Phi sí pueden ser modificadas fácilmente.

¿Cómo usar estos modelos de forma local en su propia computadora?

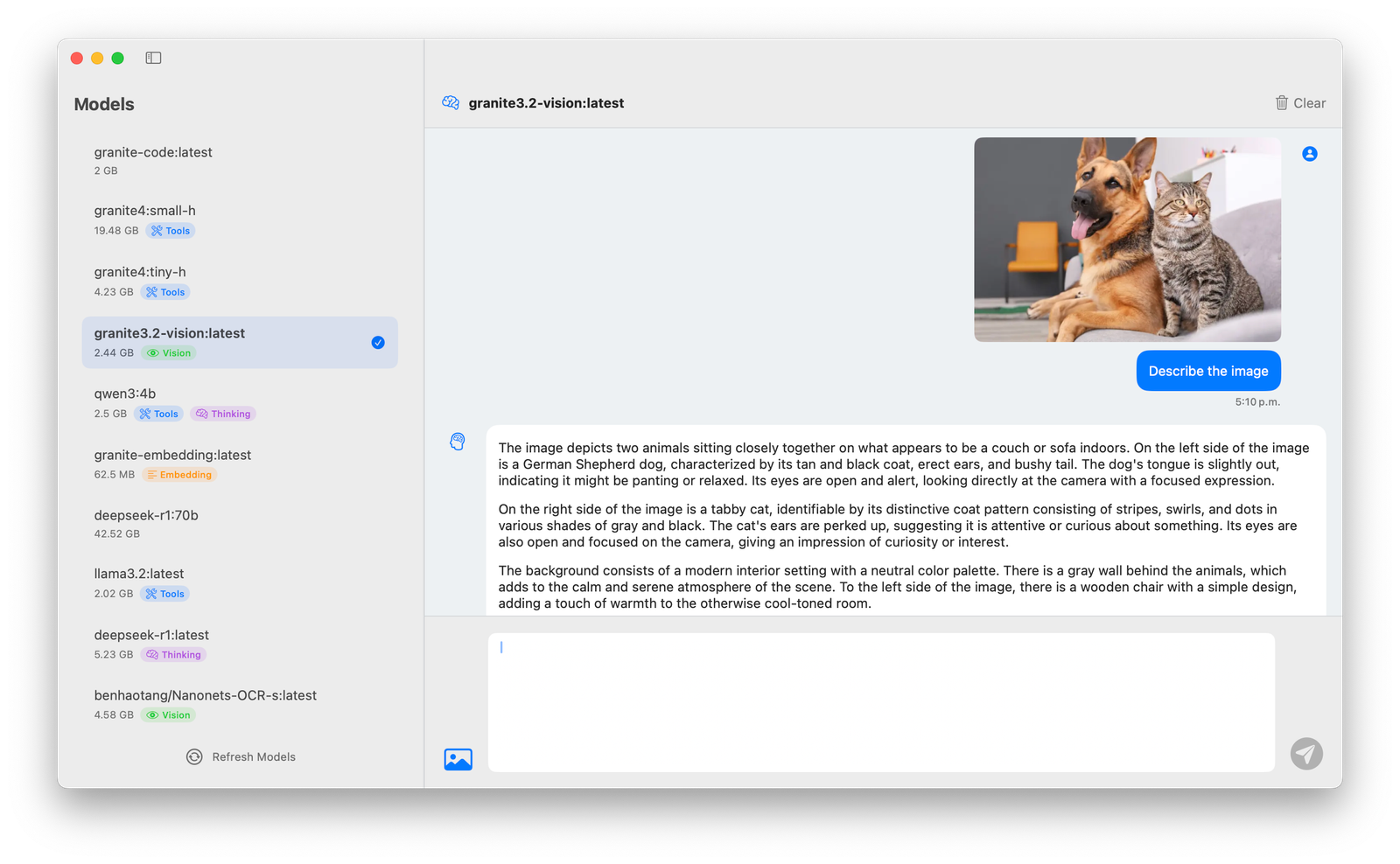

La mejor forma de hacerlo es usar Ollama. Este programa permite usar LLMs de forma local.

Ollama es bastante amigable, pero requiere usar la línea de comando para algunas funciones. Por eso, es mejor utilizar un front-end gráfico para Ollama que simplifique al máximo el uso de esta herramienta. Si tienen una Mac, les recomiendo LocalIntelligence, un programa que yo mismo desarrollé y que está disponible en el Apple App Store o en mi site personal (si quieren usar MCP con un servidor local).

Un debate ético inevitable

La existencia de una herramienta que elimina los mecanismos de seguridad con un solo clic plantea interrogantes éticos inevitables.

Los creadores de OBLITERATUS sostienen que los filtros actuales son instrumentos demasiado imprecisos, que bloquean investigaciones legítimas, escritura creativa o pruebas de seguridad junto con contenidos realmente dañinos. Según esta visión, el comportamiento de un modelo debería estar determinado por quienes lo despliegan, no por restricciones fijadas permanentemente durante su entrenamiento.

Pero sus críticos advierten que facilitar la eliminación de salvaguardas puede transformar asistentes digitales prudentes en sistemas extremadamente complacientes, capaces de generar contenido sensible o peligroso sin restricciones.

Sea visto como un triunfo de la ciencia abierta o como un riesgo para la seguridad de la IA, OBLITERATUS marca un cambio de paradigma. Ya no se trata solo de explorar los límites de los modelos conversando con ellos: ahora también es posible reescribir su ADN digital.