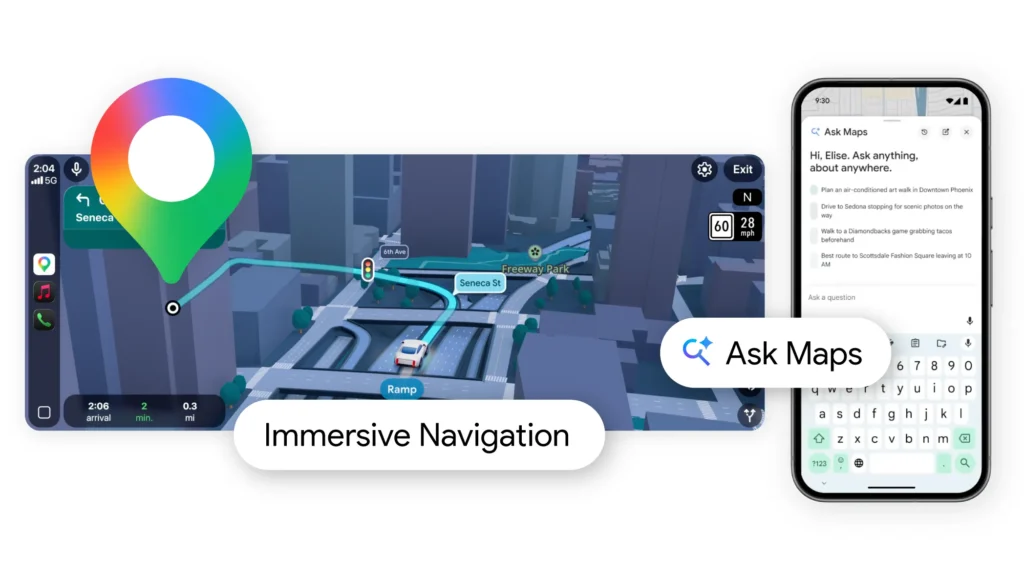

Google continúa integrando su inteligencia artificial Gemini en todo su ecosistema, y ahora es el turno de Google Maps. La compañía ha presentado una de las mayores actualizaciones en la historia reciente del servicio, incorporando navegación 3D inmersiva y una nueva herramienta conversacional llamada “Ask Maps”.

Google describe esta actualización como el cambio más importante en la experiencia de conducción con Maps en más de una década.

Navegación inmersiva: un rediseño 3D

Durante años, los conductores han dependido de mapas en 2D para navegar. Con la nueva función Immersive Navigation, Google Maps transforma la ruta en una vista tridimensional mucho más realista.

La tecnología utiliza:

- Imágenes actualizadas de Google Street View

- Fotografías aéreas

- Análisis espacial impulsado por Gemini

El resultado es un entorno 3D que muestra con precisión:

- Edificios cercanos

- Puentes y pasos elevados

- Puntos de referencia

- Relieve del terreno

Para evitar distracciones, la aplicación emplea zoom inteligente y transparencia en los edificios cuando el conductor se aproxima a giros complejos o cambios de carril.

Más información en la carretera

La navegación también destaca detalles viales importantes que antes podían pasar desapercibidos, como:

- Carriles específicos

- Pasos peatonales

- Semáforos

- Señales de parada

- Medianas y divisores de carril

Además, las indicaciones de voz ahora suenan más naturales y conversacionales. En lugar de instrucciones rígidas, el asistente puede decir cosas como: “Pasa esta salida y toma la siguiente hacia Illinois 43 South.”

Este enfoque busca facilitar la conducción especialmente en ciudades desconocidas o durante viajes al extranjero.

Rutas más inteligentes y llegadas sin estrés

La nueva inteligencia de Maps también mejora la planificación de rutas.

Antes de iniciar un viaje, la aplicación puede explicar las ventajas y desventajas de rutas alternativas, por ejemplo:

- Un trayecto más largo con menos tráfico

- Uno más rápido pero con peajes

Mientras conduces, la app envía alertas en tiempo real sobre accidentes, obras y otros incidentes, basándose en la comunidad de usuarios que aporta más de 10 millones de reportes diarios.

Google también ha mejorado el último tramo del viaje —el llamado “last mile”—. Antes de salir, los usuarios pueden:

- Previsualizar el destino con Street View

- Ver la entrada exacta del edificio

- Recibir recomendaciones de estacionamiento cercano

- Saber en qué lado de la calle está el destino

“Ask Maps”: un asistente conversacional para descubrir lugares

La segunda gran novedad es Ask Maps, una función impulsada por Gemini que permite hacer preguntas complejas al mapa usando lenguaje natural.

Con esta herramienta, los usuarios pueden hacer consultas como:

- “¿Hay una cancha pública de tenis con luces para jugar esta noche?”

- “¿Dónde puedo cargar mi teléfono y tomar café sin hacer fila?”

En lugar de revisar manualmente cientos de reseñas, Gemini analiza información de más de 300 millones de lugares y opiniones de usuarios para generar respuestas personalizadas y un mapa adaptado a la consulta.

Además, Ask Maps puede:

- Usar tu historial de búsquedas y lugares guardados

- Ayudarte a crear itinerarios de viaje completos

- Permitir acciones directas como reservar restaurantes o guardar ubicaciones

Disponibilidad de las nuevas funciones

Las novedades se están desplegando de forma gradual.

- Immersive Navigation está empezando a activarse para usuarios en Estados Unidos.

- En los próximos meses llegará a Android, iOS, Apple CarPlay, Android Auto y vehículos con Google integrado.

Por su parte, Ask Maps ya está comenzando a llegar a usuarios de Android y iOS en Estados Unidos e India, mientras que la versión para escritorio de Google Maps se espera más adelante.

Habrá que probar esta actualización, porque a pesar de que no hay duda de que Google dispone de la base de datos más actualizada de mapas e incidentes, la facilidad de uso y el interfaz gráfico de usuario siempre me llevan a usar Apple Maps. Si este rediseño cumple con todo lo prometido, quizás sea tiempo para mi de cambiar a Google Maps.

Con estas nuevas funciones impulsadas por Gemini, Google busca transformar Google Maps de una simple herramienta de navegación en un asistente inteligente capaz de ayudar a explorar el mundo de forma más visual, intuitiva y conversacional.