El gran robo de la Inteligencia Artificial: Anthropic acusa a DeepSeek y rivales chinos de copiar el talento de Claude

La empresa ha levantado la voz de alarma ante las «campañas a escala industrial» de sus competidores extranjeros. Estos buscan recolectar ilícitamente su brillante tecnología de inteligencia artificial. Anthropic, creador del popular chatbot Claude ha acusado formalmente a tres grandes firmas chinas de IA. Hablamos de DeepSeek, Moonshot y MiniMax. Anthropic afirma que estas empresas ejecutan ataques masivos de «destilación». El objetivo es acelerar el desarrollo de sus propios modelos.

En el sector de la IA, la destilación es un proceso fascinante. Los desarrolladores entrenan un modelo más pequeño usando los resultados de un sistema más avanzado.

Anthropic reconoce la validez de este método de entrenamiento. Sin embargo, los portavoces de la empresa afirman con firmeza que sus rivales usan esta técnica como un atajo injusto. Así adquieren capacidades poderosas en un tiempo récord. Además, así logran reducir drásticamente el enorme coste del desarrollo desde cero.

Las investigaciones de Anthropic revelan datos sorprendentes. Los tres laboratorios chinos crearon unas 24.000 cuentas fraudulentas. Luego, orquestaron más de 16 millones de llamadas a Claude (probablemente a través del API). Anthropic vincula estas campañas con empresas específicas con «un alto nivel de confianza». Para ello, sus expertos correlacionaron direcciones IP y analizaron metadatos. También usaron modernos indicadores de infraestructura. Además, otros líderes de la industria aportaron pruebas para confirmar estos mismos comportamientos.

Un poco de historia

DeepSeek revolucionó recientemente la industria tecnológica. Sus desarrolladores lanzaron modelos altamente eficientes y sorprendentemente poderosos. Ahora, esta empresa es el foco principal de las acusaciones. Anthropic asegura que DeepSeek realizó más de 150.000 llamadas al API. Estos buscaban copiar las avanzadas capacidades de razonamiento de Claude. Además, Anthropic acusa a DeepSeek de usar a Claude para esquivar sus propias restricciones regionales. La empresa china pidió a la IA estadounidense generar respuestas seguras contra la censura. Estas preguntas trataban temas políticos sensibles, como disidentes, líderes del partido y autoritarismo.

Las implicaciones de esta minería digital van mucho más allá del robo corporativo. Anthropic advierte de un gran riesgo. Los modelos destilados ilícitamente pierden las estrictas e importantes barreras de seguridad de la IA original. La empresa alerta de que esta brecha podría ayudar a gobiernos autoritarios. Estos podrían integrar inteligencia artificial de primer nivel en sistemas militares y de vigilancia masiva. Esto podría impulsar operaciones cibernéticas ofensivas y campañas de desinformación.

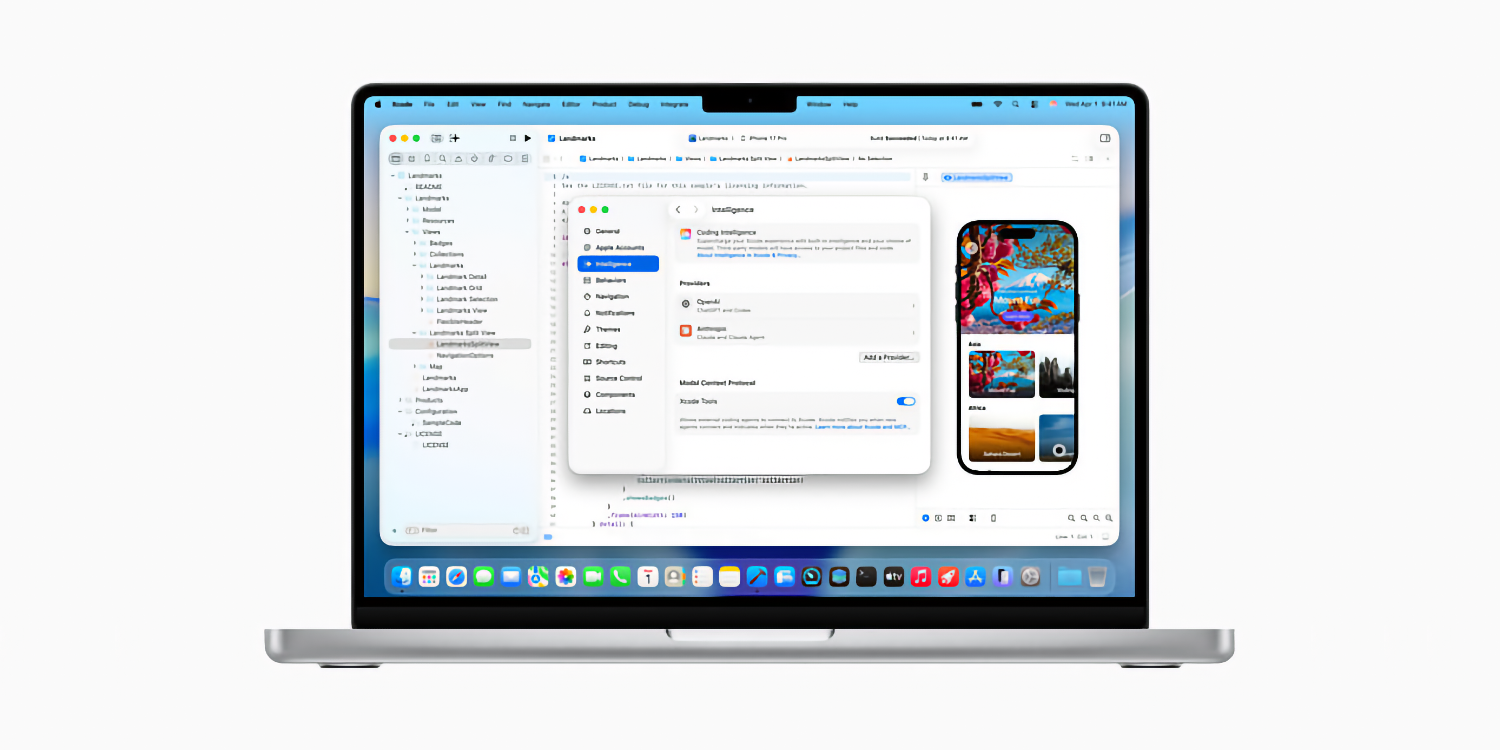

Anthropic comparte esta lucha con otros gigantes tecnológicos. Muchos competidores extranjeros intentan aprovecharse de la investigación estadounidense. A principios del año pasado, OpenAI tomó medidas contundentes. La empresa bloqueó cuentas sospechosas tras detectar que firmas rivales destilaban sus modelos. La semana pasada, OpenAI apoyó las actuales preocupaciones de Anthropic. Sus portavoces enviaron una enérgica carta a los legisladores estadounidenses. En ella, acusan a DeepSeek de «aprovecharse gratuitamente» de la innovación en IA de Estados Unidos.

¿Cuál será la respuesta de Anthropic?

Como respuesta proactiva, Anthropic promete actualizar su infraestructura. Sus ingenieros harán que los ataques de destilación sean más difíciles de ejecutar y mucho más fáciles de identificar. Sin embargo, esta controversia resalta la compleja realidad del entrenamiento de modelos de IA.

Por un lado, Anthropic señala a sus rivales extranjeros por copiar sus datos. Sin embargo, al mismo tiempo, la empresa libra sus propias batallas legales en casa. Actualmente, varios editores de música han demandado al laboratorio de IA. Ellos acusan a Anthropic de usar copias ilegales de canciones protegidas por derechos de autor para entrenar a Claude.